Le mouvement QAnon a pris une ampleur telle qu'il ne peut plus être ignoré. Voici comment les grandes plateformes numériques pourraient entraver sa progression.

Ils ont leur signe de reconnaissance, la lettre « Q », et un slogan : en anglais (« Where we go one, we go all ! ») ou en français (« Un pour tous, tous pour un ! »). Ils sont parvenus à prendre en otage le thème de la lutte contre les réseaux pédocriminels. Certains se livrent carrément à des actes de violence – le mois dernier, au Texas, une jeune femme sous l'emprise de l'alcool a foncé avec sa voiture sur des personnes qu’elle pensait être des pédophiles. D'autres se présentent aux élections au Congrès avec, parfois, des chances sérieuses de l'emporter.

Les « QAnoners », les partisans de cette théorie du complot née il y a trois ans au sein de l'Alt-Right, qui circule depuis dans les rangs des partisans les plus enthousiastes de Donald Trump et dont, en mars 2020, trois quarts des Américains disaient n’avoir encore jamais entendu parler, ne peuvent plus être ignorés.

Au sein même du Parti républicain, certains comme Liz Cheney, ont dénoncé QAnon comme « une folie dangereuse qui ne devrait pas avoir sa place dans la vie politique américaine ».

QAnon est l'exemple parfait d'une théorie du complot qui, née sur le Net, a proliféré sur les réseaux sociaux avant de faire rapidement ressentir ses effets dans la vraie vie – IRL (« in real life ») comme on dit sur Twitter.

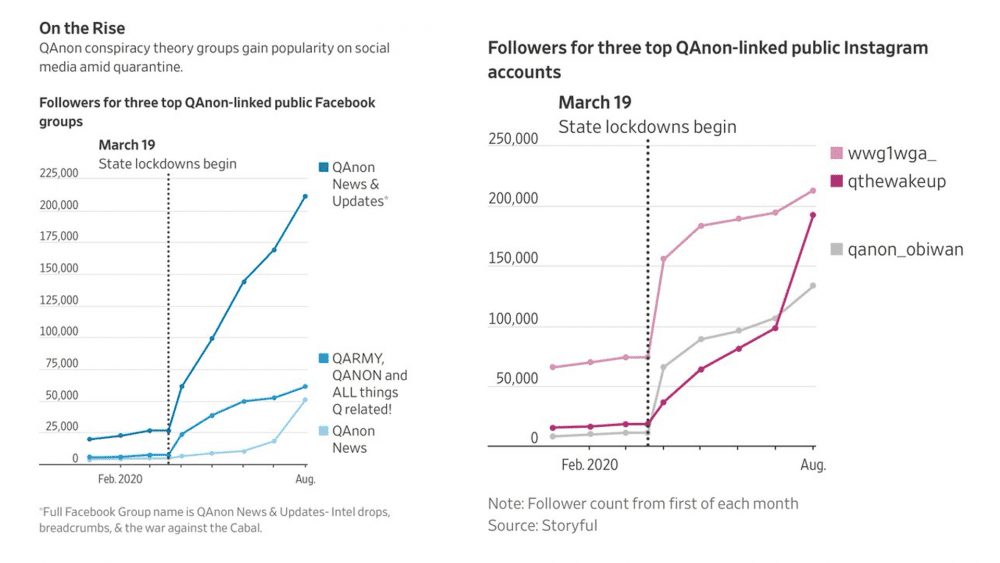

La popularité des groupes conspirationnistes faisant la promotion de ce mythe capable d'abriter et d'englober une collection impressionnante d'autres fantasmes complotistes a explosé sur Facebook et Instagram depuis le début du confinement.

De fait, les références à QAnon n'ont pas cessé de se multiplier au cours des derniers mois. Jusqu'à la nièce de Ben Laden, Noor, une fervente supportrice du président Trump qui a posté au mois de mai dernier sur son compte Twitter une photo d'elle accompagné du hashtag #QAnon.

La complosphère francophone n'est pas en reste. Du ralliement explicite aux allusions plus feutrées, QAnon se retrouve sur les sites ou chaînes YouTube du Québecois Alexis Cossette-Trudel, de la Suisse Ema Krusi, du Belge Jean-Jacques Crèvecoeur ou encore des Français Silvano Trotta et Laurent Glauzy.

Le simple fait d'en être arrivé au point où il n'est plus possible de ne pas parler de cette théorie du complot est une victoire pour les complotistes. Ce que nous disent les « QAnoners » est simple : pour eux, il existe un « État profond » où réside le vrai pouvoir et d'où une clique de pédophiles satanistes gouvernent en secret l'Amérique.

« Personne n’imaginait l'ampleur que ça prendrait », confesse Zarine Kharazian, rédactrice en chef-adjointe du Digital Forensic Research Lab de l’Atlantic Council, dans les colonnes du New York Times.

Selon elle, les plateformes comme Facebook ou Twitter pourraient mettre en oeuvre quelques règles simples pour entraver le développement préoccupant de cette théorie du complot :

1. Cesser de recommander ce type de contenus

Trop de gens découvrent QAnon parce que l'algorithme de recommandation de Facebook les a exposés à des contenus complotistes ou à des groupes qui soutiennent ce type de théories. « Il faut que cela cesse », estime Zarine Kharazian.

Mais la tâche est délicate, car les adeptes de QAnon ont par exemple infiltré des groupes de soutien aux pères divorcés ou de parents attachés à la protection de l'enfance, à l'éducation, etc. Il faudrait donc que les plateformes soient en mesure de discerner qui est qui et qui fait quoi.

2. Neutraliser les influenceurs qui relaient des contenus liés à QAnon

Les adeptes de QAnon ciblent les utilisateurs qui ont beaucoup de contacts pour en faire des relais de leurs contenus conspirationnistes.

Limiter ou bloquer ces comptes influents permettrait de faire « reculer la théorie du complot de quelques pas », explique Kharazian, qui se réjouit que les plateformes s’investissent dans ce type de démarche. Mais là aussi, la solution a son revers : l'interdiction de toute mention de QAnon, outre qu'elle relèverait de la censure, offrirait aux complotistes l'argument selon lequel on chercherait à cacher quelque vérité inavouable au public.

3. Bloquer les liens sortants

Les plateformes doivent résolument bloquer tout lien hypertexte conduisant à des applications ou sites liés à QAnon. Twitter a d'ailleurs commencé à le faire. La dissémination de ces liens pointant vers des adresses extérieures à la plateforme concernée est un moyen pour les complotistes de faire en sorte que leurs contenus demeurent accessibles indirectement, même après qu'une de leurs vidéos a été suspendue par YouTube par exemple.

4. Collaborer dans la lutte contre le complotisme

Aujourd’hui, les grandes plateformes numériques se concertent davantage sur des sujets comme la lutte contre la désinformation, la manipulation des électeurs lors des scrutins ou la prévention de la radicalisation. Pour Zarine Kharazian, cette coordination doit impérativement être étendue à la lutte contre les théories du complot.

5. Repenser les contenus des « Tendances »

De nombreux adeptes de QAnon se coordonnent pour optimiser la visibilité de leurs publications sur les réseaux sociaux et leur faire bénéficier d'un levier algorithmique via une série de hashtags sur Twitter ou Instagram. Ces « Trends » (ou « Tendances » en français) ne pourraient renvoyer qu'à des contenus à haute valeur informationnelle. Dans l'hypothèse où les plateformes ne pourraient le garantir, il conviendrait alors de limiter considérablement l'importance de ces « Trends », voire de tout bonnement les supprimer.

Ainsi, lorsque des adeptes de QAnon ont infiltré puis détourné le hashtag d'une ONG luttant contre le trafic sexuel d'enfants, les plateformes de réseaux sociaux auraient dû favoriser les voix qui expliquaient en quoi le mouvement QAnon faussait les termes de la question et parasitait une campagne de sensibilisation aux enjeux de la protection de l'enfance.

Mais, comme le relève Zarine Kharazian, « avec une théorie du complot qui évolue à une telle vitesse, cela constitue un défi de taille. »

Voir aussi :

Ces algorithmes qui favorisent la propagation des théories du complot : le cas YouTube

(Merci à P. M. pour sa contribution à ce texte)

Depuis dix-huit ans, Conspiracy Watch contribue à sensibiliser aux dangers du complotisme en assurant un travail d’information et de veille critique sans équivalent. Pour pérenniser nos activités, le soutien de nos lecteurs est indispensable.