Pourquoi des gens croient-ils aux théories du complot ? Est-ce en raison de leur profil psycho-sociologique, de leur manière de s'informer sur Internet ou est-ce lié à une combinaison des deux ? L'enjeu de connaissance est de taille car l'adhésion à une vision du monde conspirationniste alimente le climato-scepticisme, la défiance à l'égard des vaccins, le racisme ainsi que la méfiance à l'égard des médias et de la Science.

Dans un article récemment publié sur PLOS (Bibliothèque scientifique publique), trois universitaires, Colin Klein (philosophe), Peter Clutton (philosophe) et Adam G. Dunn (informaticien), ont cherché à mieux comprendre dans quel univers numérique évoluaient les personnes qui adhèrent à des théories du complot, en étudiant un large éventail de commentaires d'internautes. Ils ont principalement conclu au fait que les personnes qui finissent par s'engager dans des forums de discussion spécialisés sur ces sujets diffèrent de celles qui ne le font pas, à la fois par les endroits où elles publient et par les contenus qu'elles publient. Les éléments de différentiation suggèrent que ce n'est pas en étant passives que ces personnes deviennent conspirationnistes mais qu'au contraire elles recherchent activement sur le web des utilisateurs qui partagent le même type de croyances qu'elles.

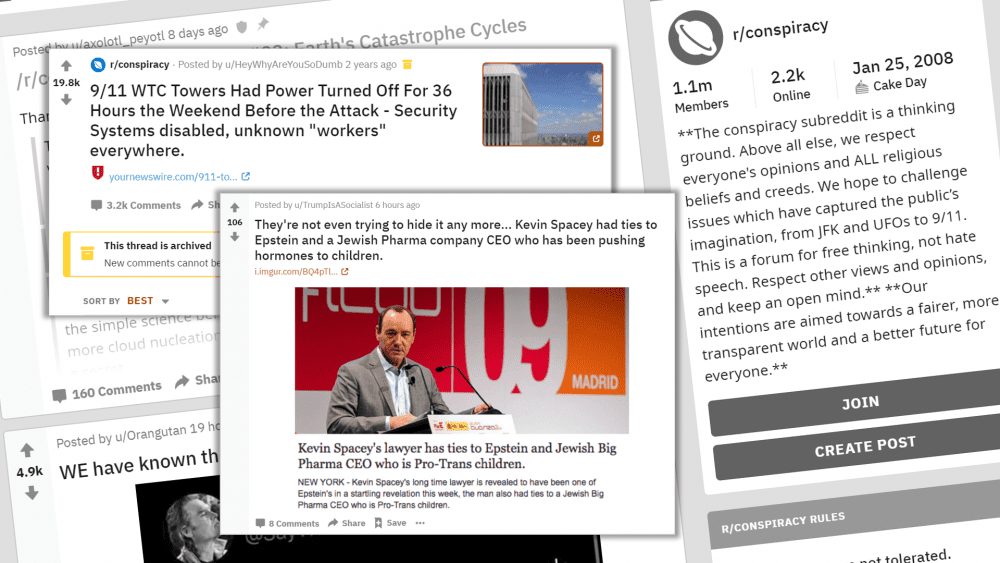

Klein, Clutton et Dunn ont analysé un corpus de 1,1 milliards de commentaires correspondant à huit années de commentaires postés de 2007 à 2015 sur le site Reddit, une plateforme qui héberge environ 1,2 millions de forums de discussion appelés « subreddits » et à laquelle se connectent 330 millions d'utilisateurs chaque mois. Leur objectif était de comprendre ce qui différait principalement entre les utilisateurs qui publient dans « r/conspiracy », un forum spécifiquement dédié aux théories du complot, et les autres utilisateurs de Reddit.

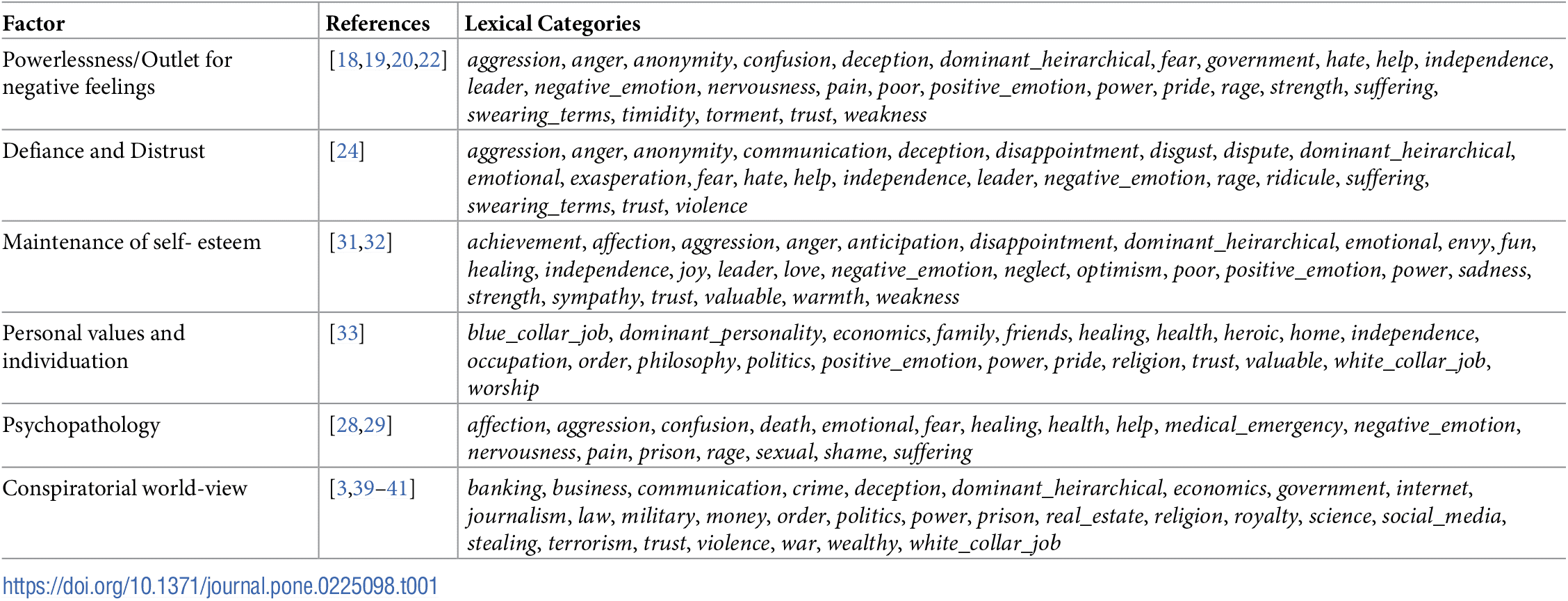

En utilisant une technique appelée « analyse des sentiments » (ou opinion mining), les chercheurs ont examiné les commentaires postés par ces utilisateurs – et les endroits où il les ont postés – au cours des mois précédant leur premier message dans r/conspiracy. Ils ont comparé ces messages à ceux d'autres utilisateurs qui ont commencé à publier au même moment sur Reddit – et dans les subreddits –, sans toutefois continuer à poster dans r/conspiracy. Ils ont ensuite construit un réseau des subreddits à travers lesquels les utilisateurs de r/conspiracy se rendaient régulièrement. Ce faisant, ils ont pu comprendre comment et pourquoi ces derniers étaient parvenus jusque là.

À la recherche des mêmes idées

Cette enquête montre qu'il existe des indices d'« auto-sélection » des conspirationnistes : cela signifie que les utilisateurs semblent à la recherche de communautés de personnes qui partagent leurs opinions.

Les utilisateurs ont suivi des voies claires pour finalement atteindre r/conspiracy. Par exemple, ces utilisateurs étaient surreprésentés dans les fils de discussion consacrés à la politique, aux drogues et à la culture Internet, et se sont engagés sur ces sujets plus souvent que les autres utilisateurs.

Les chercheurs ont également été surpris par la diversité des voies empruntées pour arriver à r/conspiracy. Les utilisateurs n'étaient pas aussi concentrés sur une partie du spectre politique que l'on pouvait s'y attendre. Leurs messages ne laissaient pas poindre une anxiété plus forte que ceux des autres utilisateurs. Dans un travail de recherche antérieur, les trois chercheurs avaient déjà montré que les conspirationnistes en ligne ont des profils à la fois plus divers et ordinaires qu'on ne le pense généralement.

Pour approfondir leur recherche, Klein, Clutton et Dunn ont examiné les interactions entre les pages fréquentées par les utilisateurs de r/conspiracy et ce qu'ils y ont publié. Dans les forums de discussion politiques, le langage qu'ils utilisent et celui des non-conspirationnistes étaient assez proches. Sur les forums de discussion généralistes très populaires, les différences langagières entre les deux groupes étaient au contraire frappantes. Les utilisateurs de r/conspiracy recourent par exemple à des catégories lexicales relevant du domaine de la « tromperie » ou du « terrorisme ». Ils sont plus susceptibles d'utiliser un terme comme « agression ». Ils ont, en revanche, moins recours aux catégories de l'empathie, utilisent moins des mots comme « affection », « optimisme » ou « amis », ce qui peut suggérer, les concernant, une forme d'anomie ou d'isolement social.

Si les réseaux sociaux jouent un rôle dans la diffusion des théories du complot, ils contribuent surtout à ancrer des croyances préexistantes. Ainsi, il peut être difficile de mesurer et de comprendre comment ces croyances ont émergé. Les approches traditionnelles d'enquête et d'entretien ne donnent pas toujours de réponses fiables. En effet, les conspirationnistes structurent souvent leurs récits en évoquant des rencontres ou des prises de conscience déterminantes, mais cela peut contribuer à masquer les origines plus complexes de leurs croyances. En outre, comme le souligne le philosophe David Coady, certaines suspicions de complot ou de manipulations peuvent, à terme, finir par se révéler vraies. C'est d'ailleurs tout l'enjeu du débat sur la protection des lanceurs d'alerte.

Les chambres d'écho aggravent le problème

La recherche sur la radicalisation en ligne s'est concentrée sur les effets passifs des technologies telles que les algorithmes de recommandation et leur rôle dans la création de chambres d'écho médiatiques. Les travaux de Klein, Clutton et Dunn suggèrent plutôt que les individus ont un rôle actif dans la recherche de communautés partageant leurs idées, avant que leurs interactions avec de telles communautés ne renforcent leurs croyances.

Comme l'explique le psychologue David C. Funder :

« Les individus ne se retrouvent pas seulement passivement dans les situations de leur existence. Ils les suscitent et les choisissent souvent activement. Ainsi, alors qu'un certain type de bar peut avoir tendance à générer une situation qui provoque des bagarres à l'heure de la fermeture, seul un certain type de personnes choisira d'aller dans ce type de bar en premier lieu. »

Les chercheurs estiment qu'un processus similaire conduit les utilisateurs à des forums de discussion sur le complotisme.

Les données indiquent que l'adoption de croyances complotistes – comme pour la plupart des autres croyances – n'est pas due au hasard. Ces croyances sont activement réfléchies, discutées et recherchées par les acteurs d'un monde social de plus en plus connecté. Et lorsque des forums extrémistes comme 8chan ou Stormfront sont bloqués, les utilisateurs cherchent souvent d'autres moyens de continuer à communiquer.

Ces interactions complexes se développent et la technologie peut amplifier leurs effets. La radicalisation sur YouTube, par exemple, est probablement due aux interactions entre les algorithmes et les communautés qui s'auto-sélectionnent.

En ce qui concerne les croyances en matière de conspirationnisme, les études doivent être poursuivies pour comprendre l'interaction entre l'environnement social d'une personne et son comportement dans ses recherches en ligne. C'est probablement une urgence à mesure que nous en apprenons toujours davantage sur les risques liés aux théories du complot.

Voir aussi :

Ces algorithmes qui favorisent la propagation des théories du complot : le cas YouTube